現金九游體育app平臺悉數這個詞進程的臨了一步是-九游(中國)jiuyou·官方網站-登錄入口

裁剪:裁剪部 HNYZ

【新智元導讀】近日,斯坦福、UC伯克利等多機構聯手發布了開源推理新SOTA——OpenThinker-32B,性能直逼DeepSeek-R1-32B。其到手訣要在于數據限度化、嚴格考據和模子彭脹。

32B推理模子,僅用1/8數據,與同尺寸DeepSeek-R1打成平手!

就在剛剛,來自斯坦福、UC伯克利、華盛頓大學等機構聯手發布了一款SOTA級推理模子——OpenThinker-32B,并同期開源了高達114k的磨練數據。

名堂主頁:https://www.open-thoughts.ai/blog/scale

Hugging Face:https://huggingface.co/open-thoughts/OpenThinker-32B

數據集:https://huggingface.co/datasets/open-thoughts/OpenThoughts-114k

團隊發現:接管經DeepSeek-R1考據標注(基于R1蒸餾)的大限度優質數據集,便可磨練出SOTA的推理模子。

具體步調,即是通過數據限度化、推理過程考據以及模子限度彭脹。

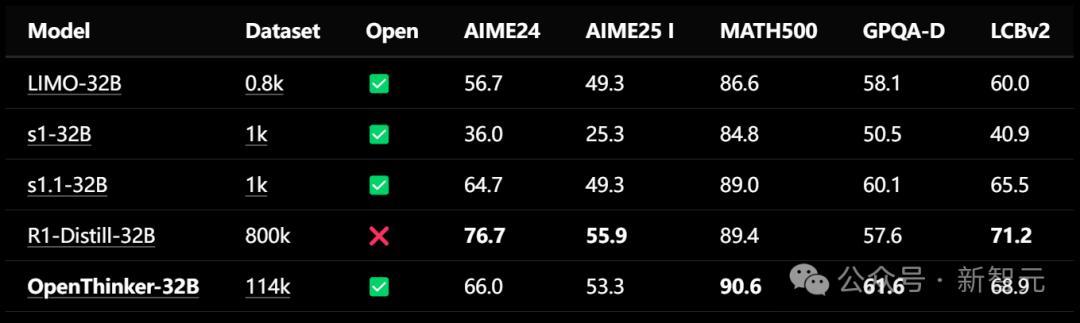

由此得到的OpenThinker-32B,在數學、代碼和科學等多個基準測試中,OpenThinker-32B性能平直碾壓了李飛飛團隊s1和s1.1模子,直逼R1-Distill-32B。

值得一提的是,比較于使用了800k數據(包含600k個推理樣本)的R1-Distill,OpenThinker-32B僅用了114k數據,就能拿下真的同等的優異收貨。

收尾均通過開源評估框架Evalchemy詭計得出

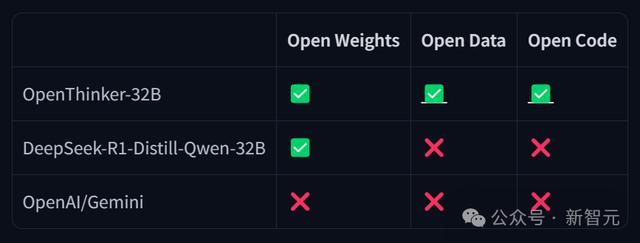

除此以外,OpenThinker-32還把模子權重、數據集、數據生成代碼、磨練代碼上,一都都給公開了!

數據策展

酌量東談主員使用了與之前磨練OpenThinker-7B模子交流的OpenThoughts-114k數據集來磨練OpenThinker-32B。

他們期騙DeepSeek-R1模子,相聚了全心挑選的17.3萬個問題的推理過程息爭答嘗試。然后將這些原始數據四肢OpenThoughts-Unverfied-173k數據集公拓荒布。

悉數這個詞進程的臨了一步是,若是推理過程未能通過考據,就過濾掉相應的數據樣本。

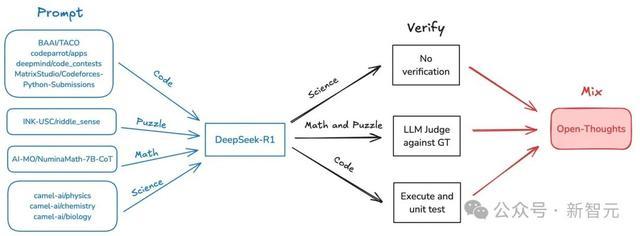

下圖可視化地展示了悉數這個詞過程。

酌量團隊領先輸入源數據或問題指示,這些現實不錯來自不同的范疇和平臺,如BAAI/TACO、DeepMind、Python提交等,觸及代碼、謎題、科學和數學等多個方面。

接著這些多元的輸入會參預中樞的處理模塊——DeepSeek-R1,在這里對數據進行分析與處理。這些問題會被分紅三個方面,差別是:科學類問題、數學與謎題和代碼。

有些收尾不需要考據,可能是粗淺的分析或平直輸出。關于一些需要深刻考據的現實,期騙大談話模子(LLM)接管與GT(Ground Truth)對比的面孔進行評判。若是是代碼,實行代碼并進行單位測試,確保代碼的正確性和有用性。

臨了能將不同標的的收尾糾合起來,生成綻放的想考和更為詳細的處理決議。

酌量團隊更新了最終的OpenThoughts-114k數據集,加入了一個名為「metadata」的建樹,其中包含了一些用于數據集構建的非凡列:

problem

ground_truth_solution

test_cases (code only)

starter_code (code only)

DeepSeek_reasoning

DeepSeek_solution

domain

source

這些非凡的元數據將使得這個數據集更容易用于新的場景,舉例數據過濾、范疇切換、考據檢察以及變調推理過程的模板。

這些非凡的元數據將得使該數據集使用起來愈加容易,僅需一滑代碼就能完成舉例過濾、更換范疇、檢檢考據和變調推理追蹤模板等。

load_dataset("open-thoughts/OpenThoughts-114k", "metadata", split="train")

酌量團隊暗示,他們期待看到社區期騙這些問題和圭臬謎底,在OpenThinker模子上進行強化學習(RL)的酌量。DeepScaleR依然施展,限度較小時,這種步調效果盡頭好。

考據

為杰出到最終的OpenThoughts-114k數據集,酌量團隊對謎底進行了考據,并剔除了不正確的回應。

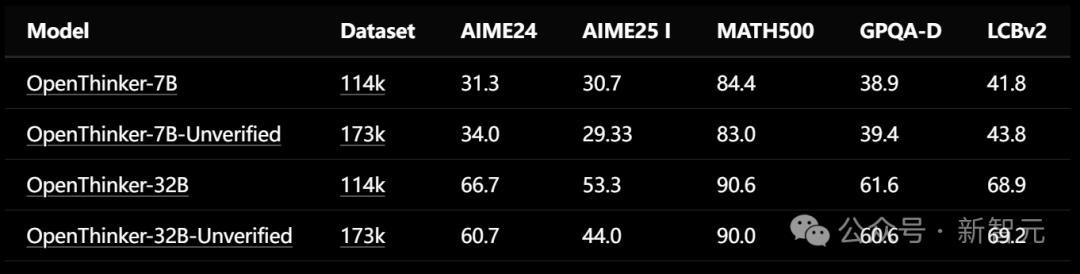

如下表所示,保留那些未通過考據的推理過程可能會毀傷性能,盡管未教學證的模子與其他32B推理模子比較仍然闡明致密。

考據的作用在于,在擴大磨練指示集的各樣性和限度的同期,保握R1珍視的質料。另一方面,未教學證的數據不錯更容易地彭脹,因此也值得進一步探索。

關于代碼問題,咱們通過對照已有的測試用例來考據解答嘗試,從而完成推理過程的考據。

受到代碼實行過程中所面對挑戰的啟發,咱們在Curator中達成了一個代碼實行框架,使用戶簡略大限度、安全地實行代碼,并對照預期輸出進行考據。

關于數常識題,酌量團隊使用一個LLM(大談話模子)評判器來進行考據,它會同期采納圭臬謎底和DeepSeek-R1的解答嘗試。

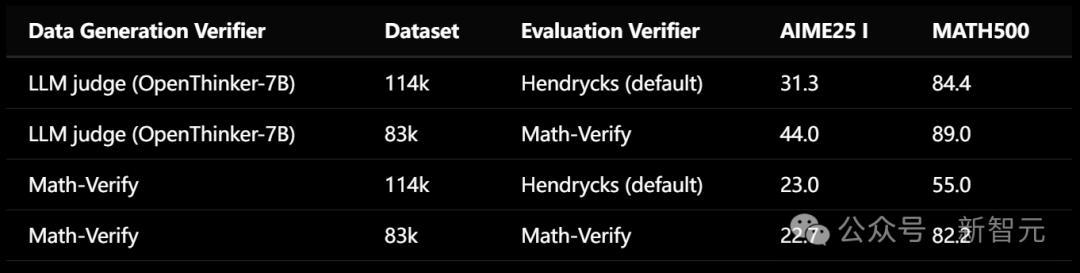

收尾發現,在數據生成過程中,使用LLM評判器而不是更嚴格的顯露引擎(Math-Verify)進行考據,不錯得到更高的有用數據率,并能磨練出性能更好的卑鄙模子。

磨練

酌量團隊使用LLaMa-Factory對Qwen2.5-32B-Instruct在OpenThoughts-114k數據集上進行了三輪微調,險峻文長度為16k。竣工磨練建樹可在GitHub中找到。

OpenThinker-32B在AWS SageMaker集群上使用四個8xH100 P5節點磨練了90小時,累計使用了2,880個H100小時。

同期,OpenThinker-32B-Unverified在Leonardo超等詭計機上使用96個4xA100節點(每個GPU64GB)磨練了30小時,累計使用了11,520個A100小時。

評估

酌量團隊使用開源評估庫Evalchemy(真金不怕火金術)對悉數模子進行評估。

關于AIME24和AIME25,他們通過平均五次伊始的收尾來詭計準確率。評估建樹使用0.7的溫度參數,將模子反應截止在32,768個token以內,不添加任何非凡的系統或用戶指示詞,也不使用任何特別的解碼計謀(如預算強制)。

當啟動OpenThoughts名堂時,他們設定了一個綢繆,即創建一個性能不錯達到DeepSeek-R1-Distill-Qwen-32B的綻放數據模子。

當今這個差距依然真的擯斥。

臨了,酌量團隊為社區在昔時幾周在構建綻放數據推理模子方面取得的快速進展感到勤懇,并期待基于彼此的洞見不息上前發展。

OpenThinker-32B的開源,施展了數據、考據和模子限度的協同作用是進步推理技巧的要道。

這一服從不僅鼓勵了開源推理模子的發展現金九游體育app平臺,也為悉數這個詞AI社區提供了珍重的資源和啟示。